Dify 是一款开源的大语言模型(LLM) 应用开发平台。它融合了后端即服务(Backend as Service)和 LLMOps 的理念,使开发者可以快速搭建生产级的生成式 AI 应用。即使你是非技术人员,也能参与到 AI 应用的定义和数据运营过程中。

入门看产品介绍

官网:https://docs.dify.ai/zh-hans

Docker的部署以及配置

开始部署

安装 Dify 之前, 请确保你的机器已满足最低安装要求:

CPU >= 2 Core

RAM >= 4 GiB

首先要部署好Docker环境以及配置拉取镜像的地址

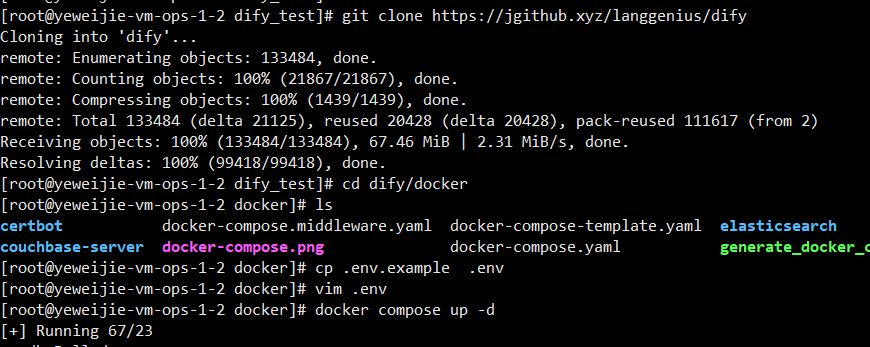

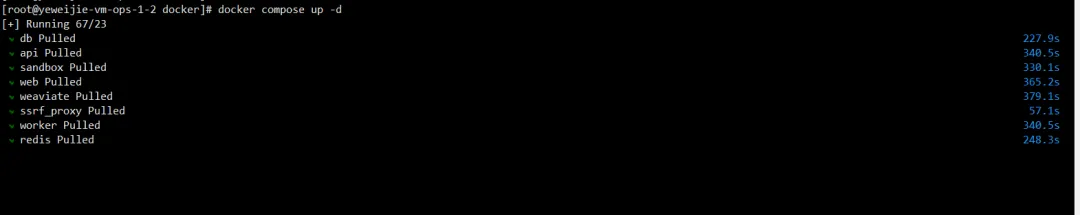

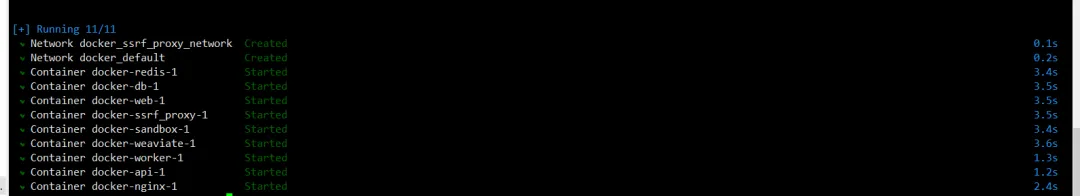

# git clone https://github.com/langgenius/dify git clone https://jgithub.xyz/langgenius/dify # 换国内的地址cd dify/dockerls cp .env.example .env vim .env # 也可以不修改docker compose up -d 网上的部署指引:

https://blog.csdn.net/u013563715/article/details/136764707

------------------

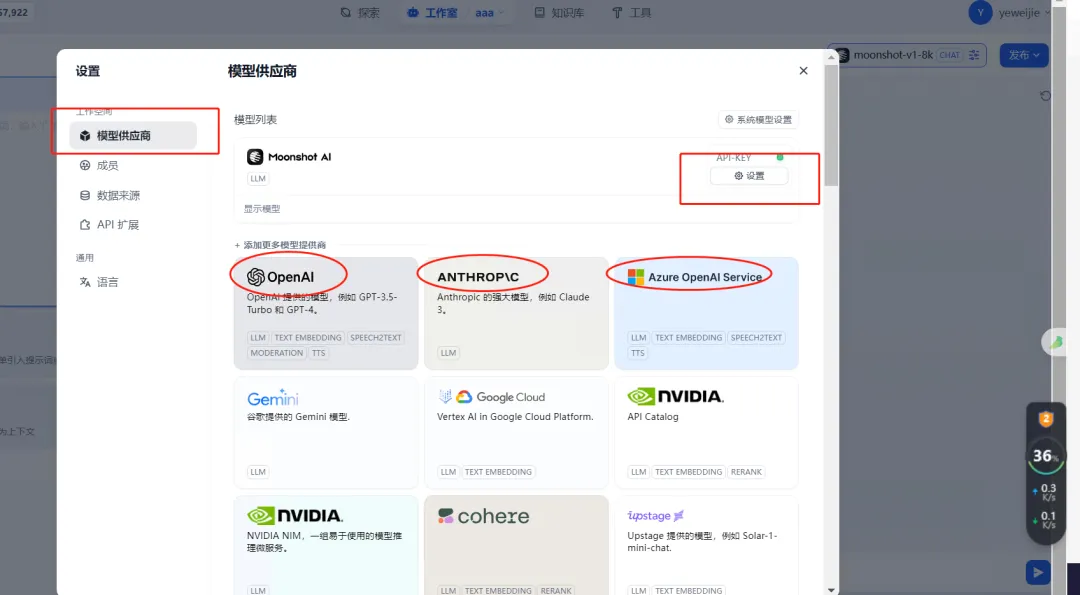

登录及配置

--------------

创建自己的语言模型(聊天助手)

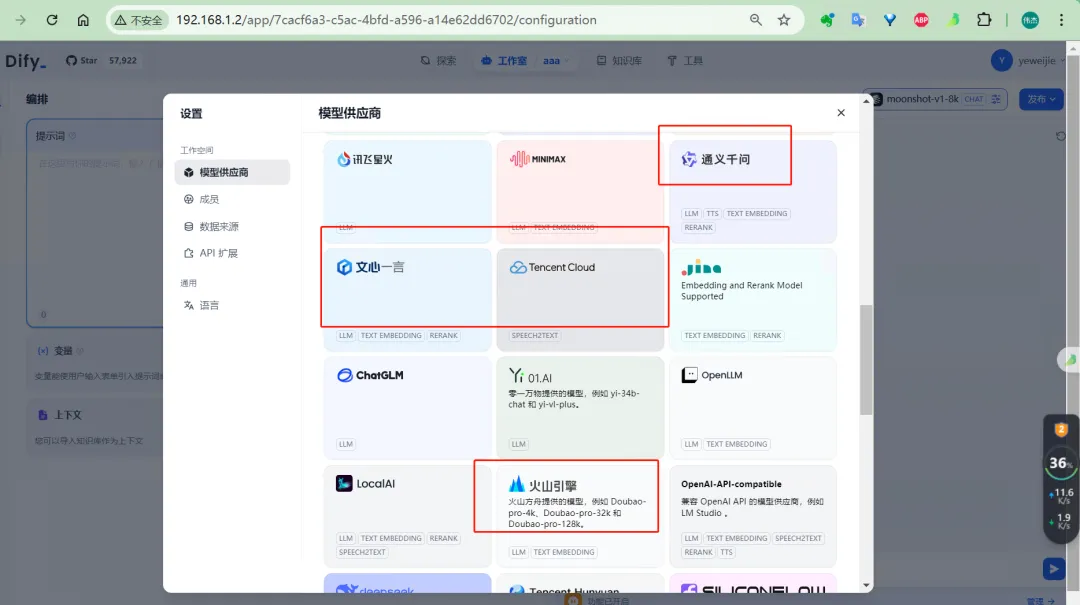

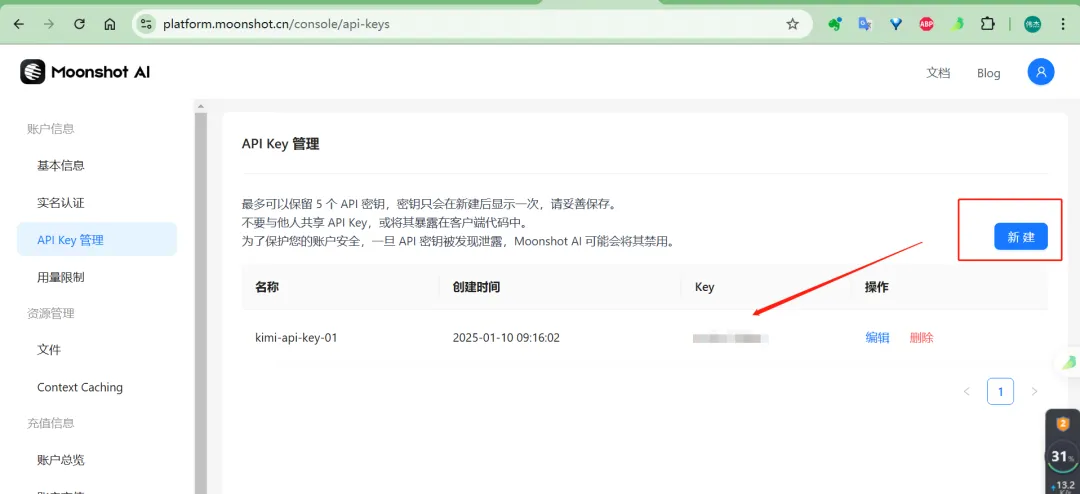

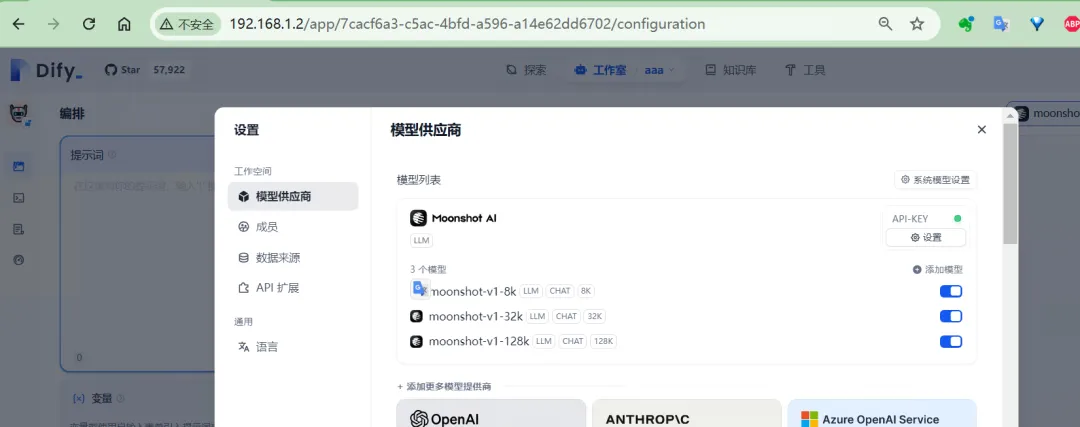

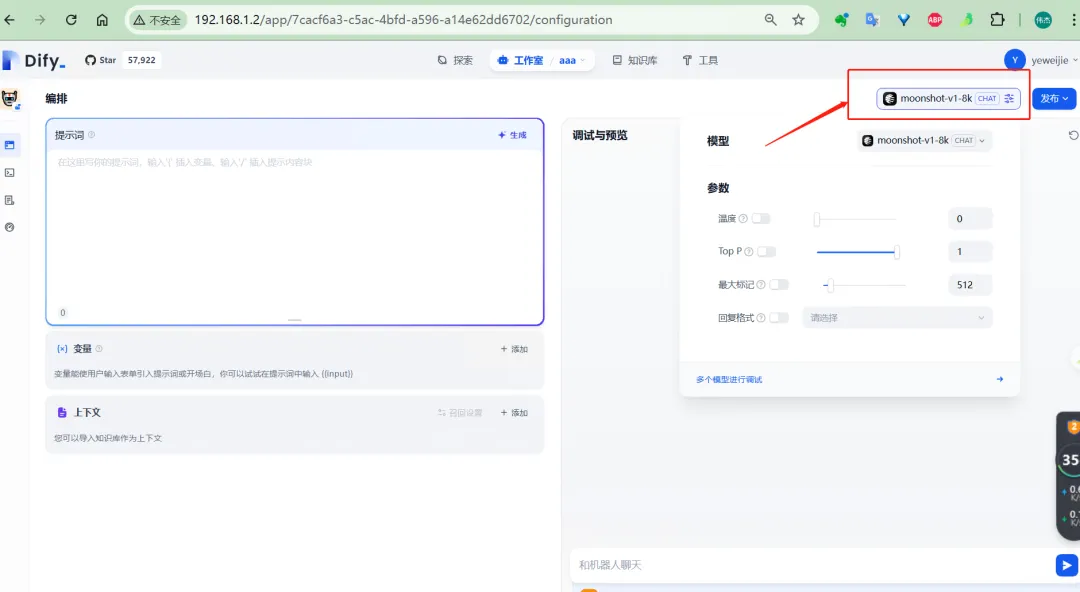

根据自己以往使用语言模型,去配置API、key。我后面用的是Kimi的key。

https://platform.moonshot.cn/console/api-keys

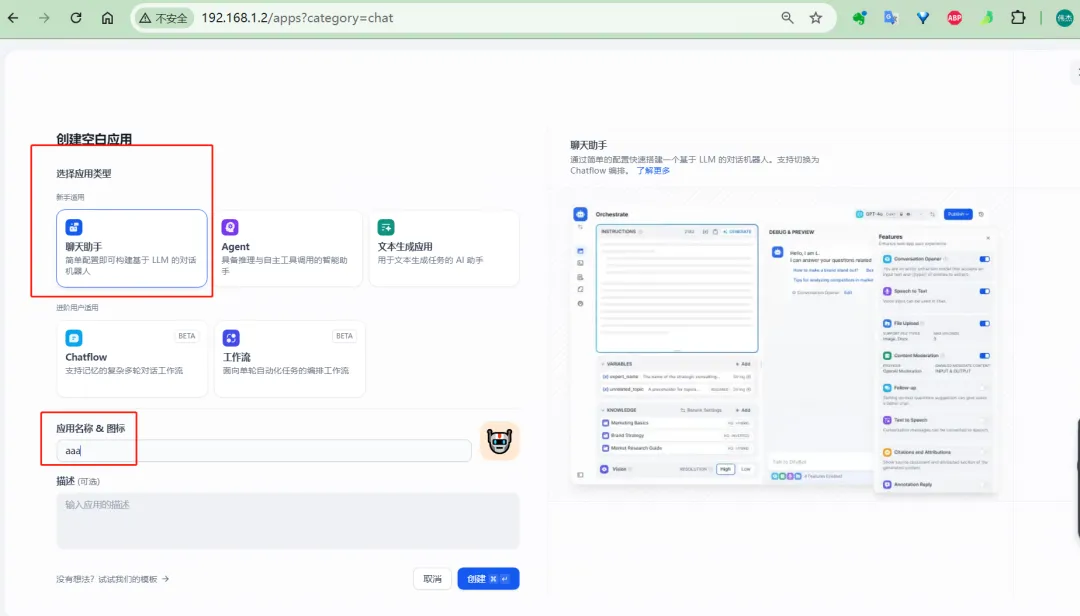

创建聊天助手

看看 回复了什么 ?

Dify是一个开源的大语言模型(LLM)应用开发平台,它提供了一系列的工具和框架,使得开发者可以更容易地构建和部署基于LLM的应用。以下是一些Dify平台的特点和推荐理由:

开源性:Dify作为一个开源平台,意味着它的代码和文档都是公开的,开发者可以自由地查看、修改和分发代码。这有助于社区协作和创新。

灵活性:Dify支持多种语言模型,包括但不限于GPT、BERT等,这使得开发者可以根据项目需求选择合适的模型。

易用性:Dify提供了简洁的API和文档,使得即使是初学者也能快速上手,构建自己的LLM应用。

扩展性:Dify的设计允许开发者轻松扩展功能,比如添加新的模型、集成新的数据源或者开发新的应用。

社区支持:作为一个开源项目,Dify拥有活跃的社区,开发者可以在社区中寻求帮助、分享经验或者贡献代码。

安全性:Dify注重安全性,提供了数据加密和访问控制等安全特性,保护用户数据和模型的安全。

性能优化:Dify在设计时考虑了性能,提供了高效的数据处理和模型推理能力,适合处理大规模数据。

跨平台:Dify支持多种操作系统和硬件平台,使得开发者可以在不同的环境下部署和运行LLM应用。

持续更新:Dify作为一个活跃的开源项目,会定期更新,引入新的功能和修复已知的问题。

教育价值:对于教育和研究领域,Dify提供了一个实践平台,学生和研究人员可以在这里学习LLM的工作原理和应用开发。

如果你对Dify感兴趣,可以访问其GitHub页面或者官方网站,了解更多详细信息,包括如何开始使用、贡献代码或者参与社区讨论。

-------

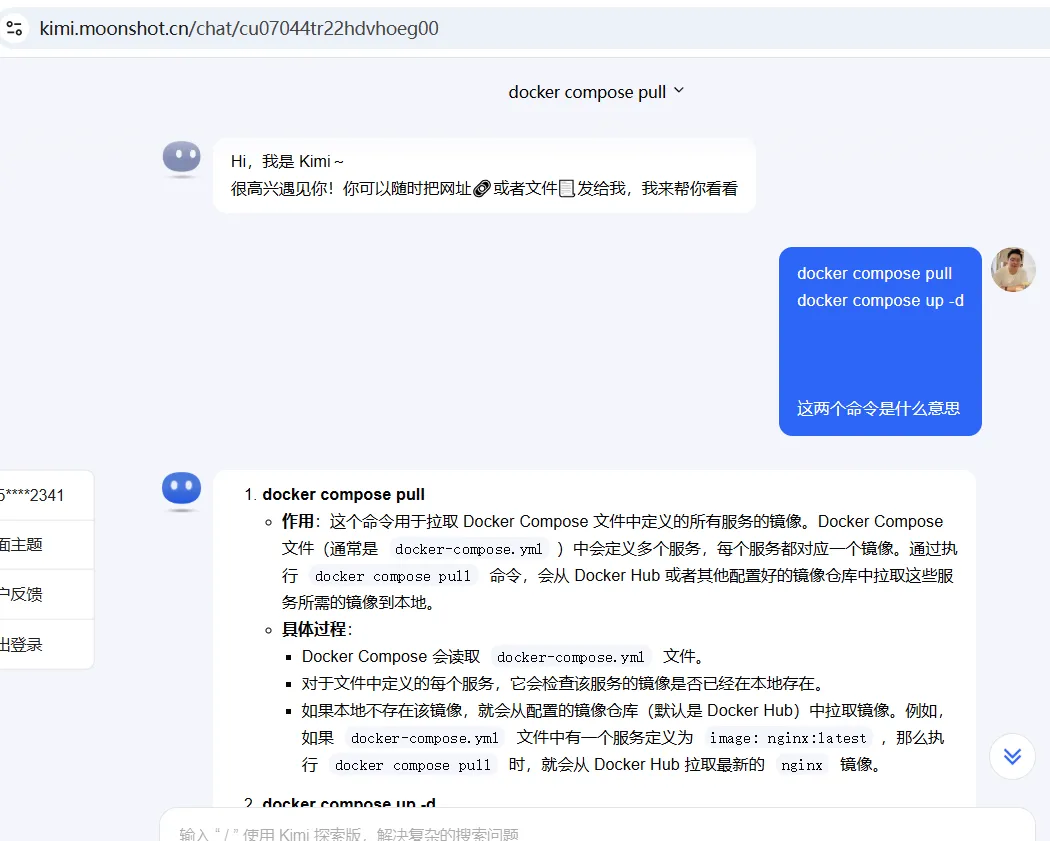

从Kimi网页去问相同一个问题

-------

今天把dify 推荐给喜好创新的你!

创业者:想要快速将AI创意落地,构建MVP或进行POC以获得投资或赢得客户订单的创业者,可以借助Dify快速搭建起具有竞争力的AI应用原型,降低开发成本和时间成本。

企业开发者:希望将LLM技术集成到现有业务系统中,提升应用智能化水平的企业开发团队,通过Dify的API和管理界面,能够方便地实现Prompt与业务代码的解耦,更好地跟踪和管理数据、成本和用量,持续优化应用性能。

大型企业IT部门:银行、大型互联网公司等企业的IT部门,可以将Dify部署为企业内的LLM网关,作为企业级LLM基础设施,加速GenAI技术在企业内的推广和应用,同时实现对AI应用的中心化监管,保障数据安全和合规性。

技术爱好者和研究人员:对LLM技术感兴趣,想要探索其能力边界、进行Prompt工程和Agent技术实践的技术爱好者,以及相关领域的研究人员,可以在Dify上轻松创建和实验各种AI应用,推动技术的创新和发展。

官网:https://docs.dify.ai/zh-hans